Imagen: Text-to-Image Diffusion Models

Imagen unprecedented photorealism × deep level of language understanding unprecedented photorealism deep level of language understanding We present Imagen, a text-to-image diffusion model with an unprecedented degree of photorealism and a deep level of la

imagen.research.google

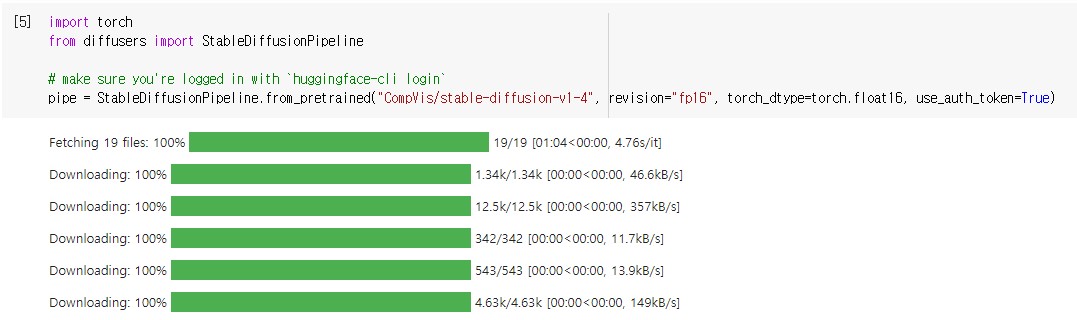

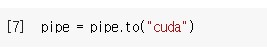

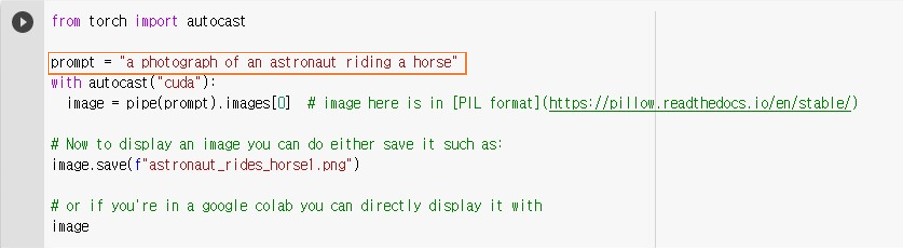

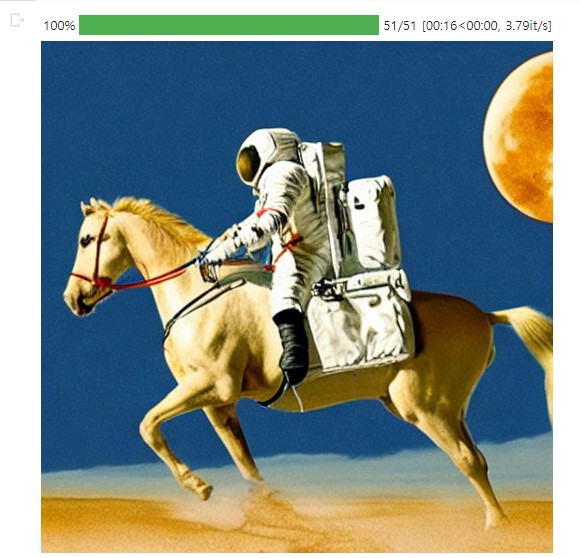

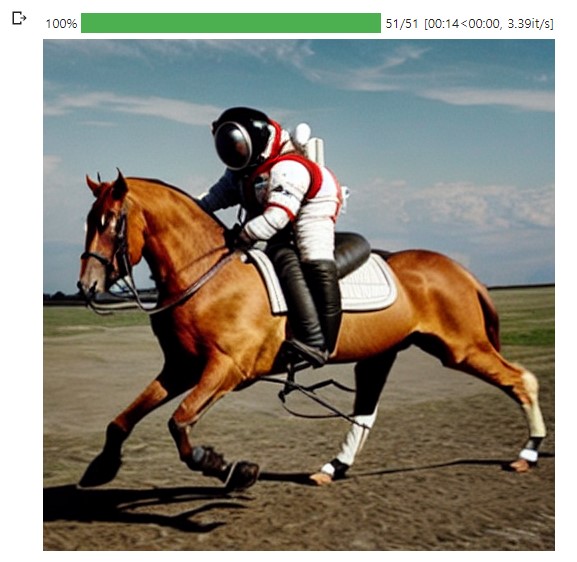

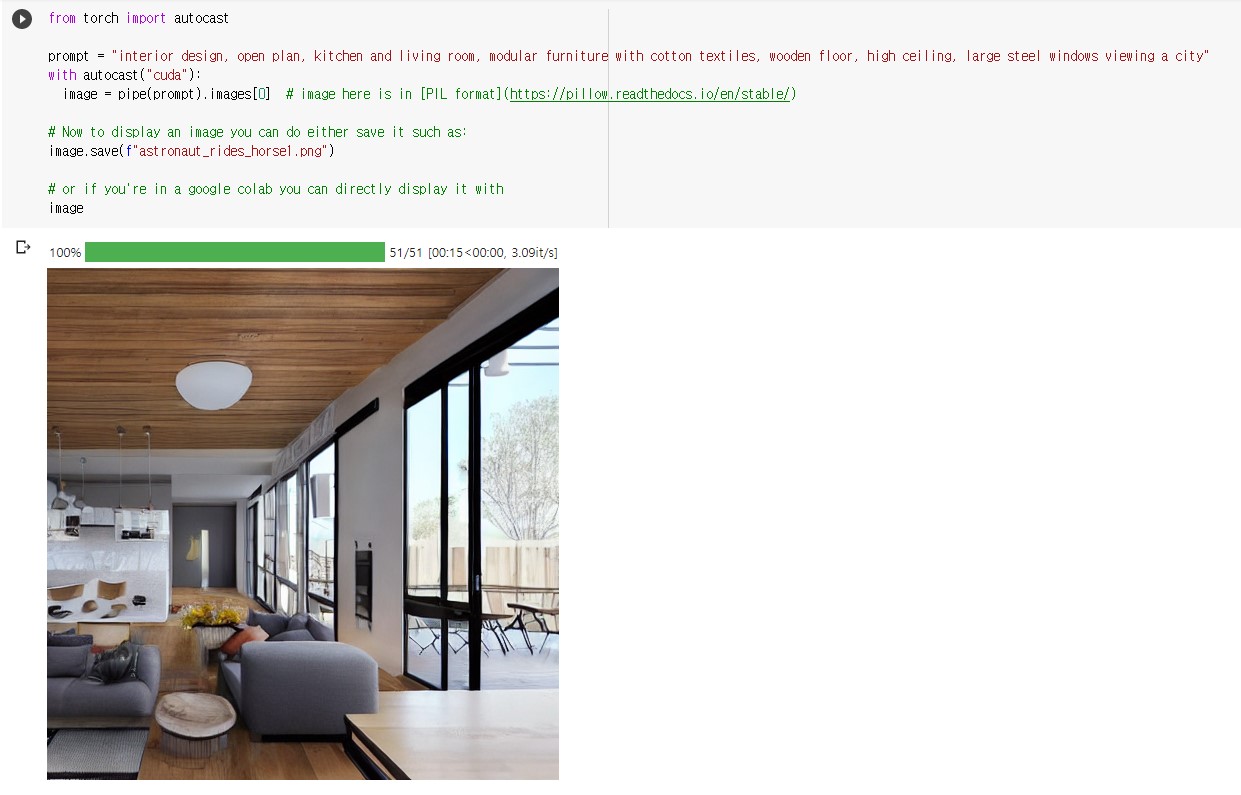

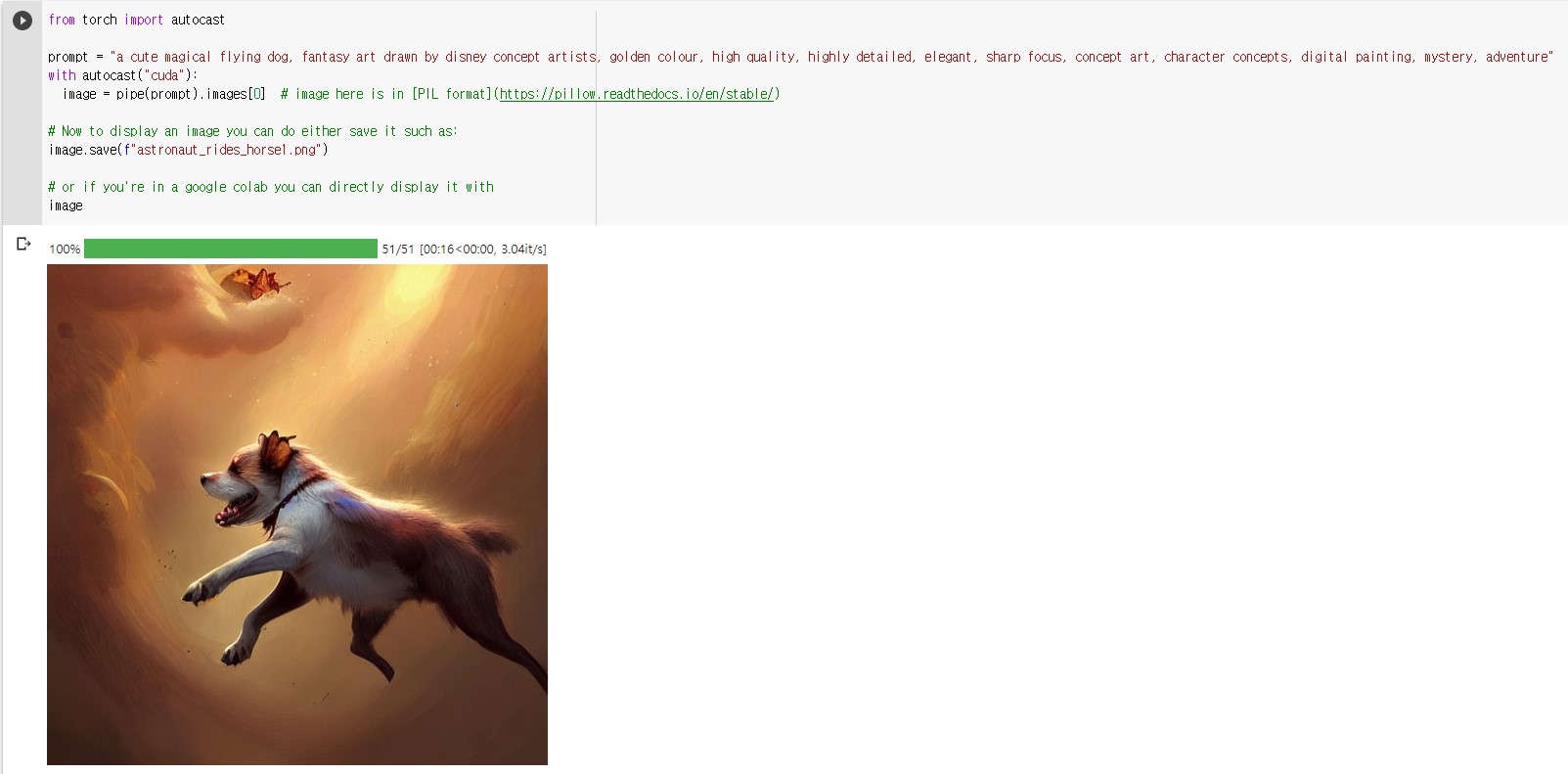

몇일전 stable_diffusion 모델을 실제로 사용해보고 딥러닝 텍스트 이미지 모델에 관심이 생겼다.

구글의 Imagen은 텍스트 입력을 기반으로 이미지를 생성하는 인공지능(AI) 이다.

텍스트를 입력하면 인공지능이 텍스트에 가장 적합한 이미지를 찾아내 명령대로 이미지를 만들어낸다.

구글의 Imagen은 텍스트를 이해하는 대형 변환기(transformer) 언어모델(T5)의 성능을 기반으로 정확도와 높은 이미지를

생성하는 확산 모델을 결합한다.

Imagen을 통해 텍스트 전용 말뭉치로 사전 훈련된 거대한 언어모델의 텍스트 임베딩이 모델 훈련에 이미지-텍스트 데이터만

사용하는 것보다 텍스트-이미지 합성에 효과적이라는 것을 발견할 수 있었다.

4월에 공개한 OpenAI의 DALL-E2 보다 훨씬 나은 성능 보여준다고 한다.

위의 Imagen 웹사이트에 들어가면 지시 텍스트와 그에 따라 출력된 결과 이미지의 사례가 몇 가지 소개되어있다.

Imagen은 무한한 창의성의 잠재력을 갖고 있지만 구글은 Imagen을 대중에게 제공하지 않기로 결정했다.

Imagen은 인터넷에서 정보를 수집하고 학습해 이미지를 생성하기 때문에 고정관념과 편견이 넘쳐날수있고

그에 따라 Imagen이 생성하는 이미지에 반영될 우려가 있기 때문이다.

<출처>

http://www.popsci.co.kr/news/articleView.html?idxno=11984

http://www.aitimes.com/news/articleView.html?idxno=144897

'AI' 카테고리의 다른 글

| [MIT Technology Review] Technology that lets us “speak” to our dead relatives has arrived. Are we ready? (0) | 2022.11.07 |

|---|---|

| <Processing> Image-Rasterizer (0) | 2022.10.11 |

| [Stable Diffusion] 딥러닝 텍스트 이미지 모델 (1) | 2022.10.06 |

| [MIT Technology Review] What does GPT-3 “know” about me? (0) | 2022.09.14 |

| [뉴스 기사] Google Search is changing, in a big way (0) | 2022.08.26 |